Als Pionier in der GPU-Technologie kennt Nvidia Datenverarbeitung und KI-Anwendungen bestens. Seit Jahren dominiert das Unternehmen den Bereich des Deep Learning und hat sich auch im wissenschaftlichen Rechnen etabliert. Nun erobert es den Markt des maschinellen Lernens – einen Sektor, der mehr als die Hälfte aller globalen Datenprojekte ausmacht.

Siehe auch: Maschinelles Lernen wird verrückt nach diesen faszinierenden Aufklebern | AI versus maschinelles Lernen: Was ist der Unterschied? | Kein Job zu klein? Wie maschinelles Lernen den Geschäftsalltag übernehmen wird

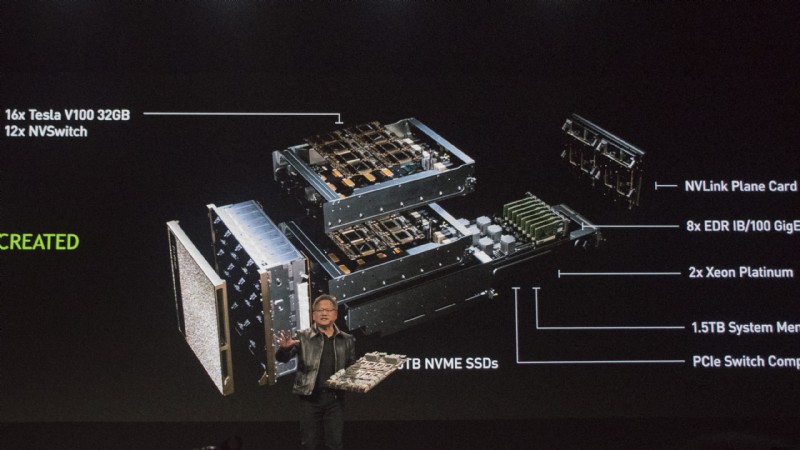

Zu diesem Zweck lancierte Nvidia die dedizierte Hardware DGX-2 sowie die Open-Source-Plattform Rapids. Diese GPU-basierte End-to-End-Lösung für maschinelles Lernen verändert grundlegend, wie Unternehmen und Institutionen ihre Daten analysieren und nutzen.

„Datenanalyse und maschinelles Lernen sind die größten Segmente des High-Performance-Computing-Marktes, die bisher nicht ausreichend beschleunigt wurden“, betonte Jensen Huang, Gründer und CEO von Nvidia, auf der GTC Europe 2018. „Weltweit führende Branchen setzen Algorithmen ein, die maschinelles Lernen auf Server-Clustern nutzen, um komplexe Muster zu erkennen und präzise Vorhersagen zu treffen – mit direktem Einfluss auf ihr Geschäftsergebnis.“

WEITER LESEN: KI vs. maschinelles Lernen – was ist der Unterschied?

Traditionell lief maschinelles Lernen auf CPU-Systemen, gestützt durch die Skalierbarkeit und das Moore’sche Gesetz. Nun, da dieses Gesetz an seine Grenzen stößt, suchen Datenwissenschaftler leistungsstärkere Alternativen. Der Markt wird auf 36 Milliarden US-Dollar (ca. 26,3 Milliarden Pfund) geschätzt – kein Wunder, dass Nvidia hier mit innovativen Produkten vorprescht.

Wir beschleunigen maschinelles Lernen wie beim Deep Learning

„Aufbauend auf CUDA und unserem globalen Ökosystem sowie in Kooperation mit der Open-Source-Community haben wir die GPU-Beschleunigungsplattform Rapids entwickelt“, erklärte Huang. „Sie integriert sich nahtlos in gängige Data-Science-Bibliotheken und Workflows und beschleunigt maschinelles Lernen enorm.“

„Wir beschleunigen das maschinelle Lernen, wie wir es beim Deep Learning getan haben.“

Ohne ins Technische zu gehen: Nvidias GPU-Systeme sind deutlich schneller als traditionelle CPU-Lösungen.

WEITER LESEN: Mit neuronalen Netzen Kunst machen

In einer Live-Demo verarbeitete die Plattform 16 Jahre Hypotheken- und Kreditdaten eines großen Maklers in nur 40 Sekunden – auf einem CPU-basierten Python-System dauert das etwa zwei Minuten.

Bei komplexeren Modellen zur Verhaltensvorhersage (z. B. Kreditausfallrisiko) braucht ein 100-CPU-System eine halbe Stunde, ein 20-CPU-Array noch länger. Mit DGX-2 und Rapids erledigt sich das in rund zwei Minuten – der Zeit, die Huang für die Erklärung benötigte.

Das spart Zeit für Datenwissenschaftler und beschleunigt Lernprozesse in Unternehmen. Ein DGX-2 ersetzt 300 Server; die Anschaffung kostet über 3 Millionen US-Dollar, bietet aber unvergleichliche Leistung.

WEITER LESEN: Googles Cloud AutoML macht maschinelles Lernen für alle zugänglich

Nvidia kooperiert bereits mit Großkonzernen: Walmart optimiert Bestandsmanagement und reduziert Lebensmittelabfälle. HPE verbessert ML-Angebote, IBM integriert es in Watson, und Oracle nutzt Rapids und DGX-2 für Cloud-Insights.

Rapids und DGX-2 demokratisieren maschinelles Lernen: Auch Unternehmen ohne eigene Serverfarmen oder Armeen von Experten können nun skalieren. Diese Technologie verändert nachhaltig das Geschäftsmodell vieler Firmen.